Autor: Oliver Lukitsch

Dies ist ein Vorgeschmack auf ein bald erscheinenden Artikel über die Fallstricke der generativen KI, geschrieben von unserem Mitgründer Markus Peschl. Wir werden es hier verlinken, sobald es veröffentlicht ist.

Die KI-Revolution ist in den Medien allgegenwärtig, und das zu Recht. Die Leistungen der Technologie sind in der Tat beeindruckend. Doch genauso wie über die erstaunlichen Schöpfungen der generativen KI (z.B. ChatGPT) gestaunt wird, betonen Beobachter*innen und Expert*innen, dass KI-Systeme noch weit davon entfernt sind, menschliche Kreativität ersetzen zu können. Mehr noch: Es wird betont, wie sehr sich die schöpferische Kraft der KI von der Kreativität des Menschen, der sie entsprungen ist, unterscheidet.

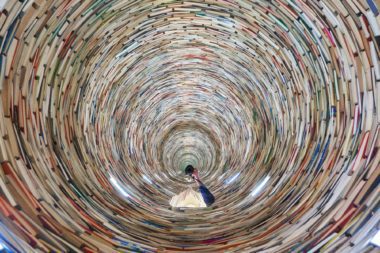

Aber auch wenn es noch keinen künstlichen Ersatz für menschliche Kreativität gibt, besteht die Gefahr, dass die Leistungsfähigkeit und Zugänglichkeit von KI-Werkzeugen unsere Kreativität durch einen unkreativen Mechanismus zur Wiederverwertung vorhandenen Wissens ersetzt. Wir könnten in einen Teufelskreis geraten, in dem wir immer mehr vom Gleichen reproduzieren. Aber wie könnte das passieren, was wären die Folgen und wie können wir es vermeiden?

Auch wenn es der künstlichen Intelligenz noch an menschlicher Handlungsfähigkeit und Kreativität mangelt, so hat sie doch die unheimliche Macht, unsere menschliche Umwelt körperlos zu machen. Es wird wichtiger denn je sein, den menschlichen Geist und seine außergewöhnliche Kreativität im Spiel zu halten.

Aus der Vergangenheit lernen

Auf den ersten Blick sind die Fähigkeiten von ChatGPT beeindruckend. Wir führen ein nahtloses Gespräch mit dem Bot. Seine Antworten sind fließend, verständlich und oft überzeugend. Nicht nur das Wissen, das er „besitzt“, ist beeindruckend, sondern auch die Art und Weise, wie er zitiert und paraphrasiert.

Die so genannten „Large Language Models“ (LLM) haben jedoch starke Einschränkungen. Sie liefern zwar überzeugende Antworten, haben aber oft ein unzuverlässiges und unvorhersehbares Verhältnis zur Wahrheit. Der Grund dafür liegt in der kognitiven Architektur der KI verborgen. LLMs (und viele andere KI-Systeme) „verstehen“ die Welt um sie herum nicht; sie haben kein ganzheitliches Modell ihrer Umwelt. (Streng genommen erfassen sie nicht einmal die Bedeutung der Sätze, die sie generieren.)

Vielmehr sind ChatGPT und Co. eine sehr ausgefeilte Form des „auto-complete“. Sie vervollständigen Sätze, indem sie die nächste Wortreihe anhand des bereits Bestehenden vorhersagen. Und sie sind dazu in der Lage, weil sie anhand von gigantischen Datenmengen trainiert worden sind. Auf diese Weise kann „generative“ KI mehr als einfach nur vorhandenen Text zu kopiert, sondern eigene Antworten auf Benutzer*Innenanfragen erstellen. Es entsteht daher der Eindruck von Originalität und Kreativität.

Gerade deswegen ist es wichtig, die Grenzen des Systems zu verstehen. Die Sätze und Bilder, die es erzeugt, werden aus bestehenden Mustern abgeleitet, die in der riesigen Datenmenge (die fast ausschließlich aus dem Internet stammt) extrahiert wurden. Mit anderen Worten: Die generative KI versucht, bestehende Regelmäßigkeiten aus der Vergangenheit zu identifizieren und zu reproduzieren, anstatt der Gegenwart etwas Neues hinzuzufügen.

Ein Teufelskreis des Wissensrecyclings

Es ist in erster Linie beeindruckend, dass eine Technologie in der Lage ist, aus riesigen Datensätzen ihre eigenen Schlüsse zu ziehen und darin Muster zu lesen. Sie ist ein fantastisches Werkzeug – solange wir uns ihres schwierigen Verhältnisses zu Wahrheit oder Realität bewusst sind.

Doch werfen wir zunächst einen Blick auf die „Wissensbasis“, auf die die generative KI zurückgreift – mit anderen Worten, woher sie ihr Wissen bezieht.

Kurz gesagt, Systeme wie ChatGPT wurden mit riesigen Datenmengen aus dem Internet gefüttert. Ein signifikanter Anteil dieser Daten und Inhalte wurde auf verschiedenste Weise von Menschen erstellt. Und viele der Daten, mit denen KI Systeme wie ChatGPT gefüttert werden, sind das Ergebnis echter menschlicher Kreativität, wie Geschichten, die von menschlichen Autor*innen geschrieben, oder wissenschaftliche Erkenntnisse, die von menschlichen Köpfen gedacht wurden.

KI wird jedoch auch ihren eigenen Inhalten trainiert und lernt durch die erfolgreiche Produktion von Ergebnissen, die von den Nutzer*innen als positiv, hilfreich und nützlich angesehen werden. Auf diese Weise kommt es zu einem sich selbst verstärkenden Aufbau von „Wissen“ (zumindest aus der Perspektive der User*innen).

Zentral ist jedoch eine weitere sich abzeichnende selbstverstärkende Schleife: Da KI in der Lage ist, in extrem kurzer Zeit große Mengen an Inhalten zu generieren, bedeutet dies auch, dass das Web bald mit KI-generierten Inhalten „überschwemmt“ sein wird. Die KI wird also eine beträchtliche Menge an Daten generieren, anhand derer sie in Zukunft erneut trainiert werden.

Ist das eine schlechte Sache? Die Aussicht ist der geschilderten Logik nach schlecht. Der Teufelskreis des Wissensrecyclings birgt die Gefahr, dass eine Schleife sich wiederholender Wissensproduktion entsteht, die immer weniger Vielfalt und Originalität in den produzierten Inhalten aufweist. Aber warum?

Das Ende echter Kreativität

Wir gehen oft davon aus, dass menschliche Kreativität etwas ist, das von unserem Gehirn realisiert wird und nur in unserem Kopf stattfindet. Dies ist zwar nicht falsch, aber eine beachtliche Verkürzung.

Die Kognitionswissenschaft hat immer wieder gezeigt, dass (natürliche) Kreativität eine verkörperte, explorative Auseinandersetzung mit unserer Umwelt erfordert. Kreativität ist nicht etwas, das nur in unseren Köpfen stattfindet, sondern etwas, das in unserer Auseinandersetzung mit der uns umgebenden Welt geschieht. Eine derartige verkörperte „Entdeckungsreise“ bedeutet etwas ganz anderes als der vorhersagende und sich auf die Vergangenheit beziehende Ansatz der LLMs. Bei der menschlichen, verkörperten Kreativität geht es darum, noch unbestimmtes, nicht vorhersagbares Potential aufzudecken und zu formen, anstatt die wahrscheinlichsten Ergebnisse vorauszusehen.

Die für ihre scheinbare Schöpfungsgabe gehypten KI-Systeme, haben im Vergleich dazu aber keinen Zugang zur Welt. Sie nehmen diese weder direkt wahr noch können sie diese (sozusagen physisch) explorieren, um so etwas wirklich Neues entstehen zu lassen.

Die heutigen KI-Systeme sind jedoch nicht völlig von der menschlichen Kreativität abgekoppelt. Schließlich greifen sie auf die enormen Ressourcen menschlicher Kreativität zurück und werden an ihr geschult. Generative KI mag zwar über keine menschliche Kreativität verfügen, aber sie greift letztlich auf deren Originalität zurück.

Welche Schlüsse lassen sich daraus ziehen? Die nun so gehypten KI-Systeme sind nicht aus sich heraus kreativ – aber es ist daher umso wichtiger, menschliche Kreativität kontinuierlich in die Lernschleifen von generativen KI-Systemen einzuspeisen.

Wie sich der Teufelskreis der Unkreativität vermeiden?

Um den Teufelskreis zu durchbrechen, der mit der Zeit entstehen kann, wenn immer mehr Menschen KI in ihrer kreativen Arbeit einsetzen, müssen wir die Bedingungen und Kontexte berücksichtigen, in denen echte Neuerungen entstehen. Radikal neues Wissen entsteht, wenn sich menschliche Akteure mit ihrer materiellen Umgebung auseinandersetzen; wie Bildhauer*innen, die eine Skultur aus Marmor meißelt, Töpfer*innen, die eine Vase aus Ton formen.

Die verkörperte Interaktion und der Kontakt mit der uns umgebenden Welt ermöglichen es dem Menschen, die Potentiale zu erspüren, die in seiner Umgebung schlummern und diese zur Realität werden zu lassen.

Wir Menschen können Neues schaffen, nicht weil wir es vorhersagen, sondern weil wir auf körperliche Weise in unsere Umwelt eingebettet sind, auf diese einwirken können und so einen unendlichen Raum unverwirklichter Möglichkeiten erschließen. In diesem Raum kann das wirklich Neue dann entstehen.

Um also den Teufelskreis des KI-Wissensrecyclings zu durchbrechen, ist es essentiell, fortwährend menschliche Kreativität in die Trainingsdatensätze einfließen zu lassen. Die Organisationen und Unternehmen, die die kommenden Versionen und Generationen von generativen KI-Modellen entwickeln und trainieren werden, sollten das berücksichtigen: Es gilt sicherzustellen, dass die Daten, mit denen sie arbeiten, eine beträchtliche Menge an Text, Bild und Ton enthalten, der menschlichem Schaffen entspringt.

Zusammengefasst: Generative KI schafft Pseudo-Neuheiten, indem sie reproduziert, was sie bereits „weiß“. Menschen schaffen Neues, indem sie es in Interaktion mit der Außenwelt gestalten. Indem das von Menschen erzeugte Neue in den Kreislauf der Wissensproduktion eingespeist wird, können generative KI-Systeme maximal nützlich bleiben – und so verhindern, dass sie lediglich altes Wissen recyceln.

Eine wiederverwertete Welt

Ein letzter Appell zur Vorsicht. Die Interaktion zwischen Mensch und Maschine findet nicht nur in einer virtuellen Sphäre statt, wie die bereits genannten Punkte vermuten lassen.

Die Artefakte, die wir durch die Interaktion mit KI ins Leben rufen, werden zur „Ausstattung“ unserer Welt und sozialen Umfelds von morgen. Die von uns geschaffenen Technologien können ihrerseits die Welt um uns herum tiefgreifend verändern – und prägen unser Leben so auf weitreichende Weise. Denken Sie nur daran, wie das Internet und die sozialen Medien die Welt, in der wir heute leben, geformt haben.

Die generative KI verspricht eine ähnliche Umwälzung. Wir sind dabei eine Welt zu erreichten, in der KI Systeme aus unserem Leben nicht mehr wegzudenken sind.

Umso mehr müssen wir darauf achten, dass wir nicht zulassen, dass eine körperlose, entmenschlichte Technologie zur Grundlage unserer Existenz wird. Genau diesen Pfad könnten wir aber unwillkürlich beschreiten, in dem wir menschliche, verkörperte Kreativität mehr und mehr aus der Regelschleife der KI-basierten Wissensentstehung zurückziehen.

Es ist aber gerade unsere Umwelt, die voller menschlicher Artefakte und Zeugnisse unserer Kreativität ist, über die wir uns als Menschen wahrnehmen. Dieses Selbstverständnis könnte jedoch durch eine Technologie verdrängt werden, die einen Teufelskreis des Wissensrecyclings immer weiter vorantreibt.

Eine positive Aussicht

Generative KI ist alles andere als ein dunkler Pfad. Ganz im Gegenteil. Es gibt eine Fülle von Möglichkeiten, viele noch kaum absehbar, wie die menschliche Gesellschaft profitieren kann.

Kognitive Technologien haben ein neues Niveau und eine neue Qualität der Automatisierung von Wissensarbeit zutage treten lassen, sodass weniger interessante, aber dennoch anspruchsvolle Arbeit an Maschinen ausgelagert werden kann. Natürlich fürchten viele um ihren Arbeitsplatz, aber ein sozial ausgewogener digitaler Wandel kann für viele von uns ein besseres Leben bedeuten und ureigene menschliche Kapazitäten und Potentiale freisetzen.

Dies führt uns zu einem weiteren Punkt. Die KI-Technologien haben bereits begonnen, den Druck zu erhöhen, radikal zu überdenken, wie menschliche Bildung, Kognition, Lernen, Lehren und Wissensproduktion in einem Zeitalter aussehen sollen, in dem Menschen Seite an Seite mit intelligenten Maschinen arbeiten.

Unsere Bildungssysteme können sich endlich vom (mehr oder weniger ausgeprägten) Ansatz des „Auswendiglernens“ oder der Wissensspeicherung verabschieden und dringend benötigte Metakompetenzen fördern, wie z.B. die Fähigkeit, in einer unsicheren Welt Urteile zu fällen, kritisch zu reflektieren, aber auch kreativ zu denken und zu handeln.

Wir stehen vor einem Wandel, der bereits begonnen hat. Umso wichtiger wird es sein, dass wir uns nicht blind von der Technologie leiten lassen, die diesen Wandel herbeigeführt hat. Vielmehr sollten wir unsere gestalterische, menschliche Handlungsfähigkeit neu beleben und als treibende Kraft im Zusammenspiel mit dieser so spannenden Technologie begreifen.

Newsletter abonnieren

Erhalten Sie besondere Einblicke in die neuesten Entwicklungen.

Image by D-Koi @ Unsplash